Tout (fr)

-

Freeteuse - Télécommande pour Freebox

(Journaux LinuxFR)

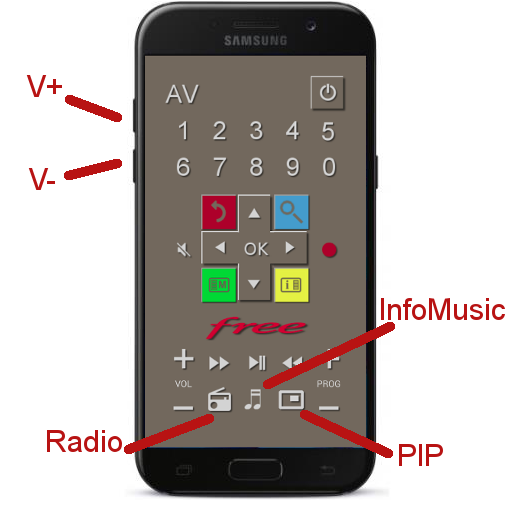

Freeteuse

Je m'apprête une nouvelle fois à retourner ma télécommnade au SAV. En attendant d'en recevoir une nouvelle, plutôt que d'installer comme je le faisait habituellement une appli récupérée sur le playstore j'ai préféré en développer une directement.

D'abord parce que c'est assez rapide et plutôt marrant à faire, mais aussi parce que j'avais été assez déçu par toutes celles que j'avais pu essayer jusqu'ici. Plusieurs choses me déplaisent chez elles :

Publicité

Celle-ci est devenue vraiment insupportable et est absolument incompatible avec l'usage que l'on veut faire d'une télécommande. C'est tout bête, mais une application avec laquelle il faut attendre la fin de vidéos d'annonces avant de pouvoir s'en servir est tout sauf une télécommande.Code d'appariement à saisir

Là nous sommes plutôt dans le domaine du "pourquoi faire simple quand on peu faire compliqué". Le SDK fournit par Free est sans procédure d'appariement et pourtant la quasi totalité des applications en demande une à leurs utilisateurs. Cette curiosité a en fait en explication qui est plutôt à chercher dans le profil des développeurs qui je pense ne savent pas utiliser le SDK et se contente de l'API http dont l'avenir a déjà été mis en cause par Free.Latence au démarrage

Mon autre source d'agacement est la sensation avec certaines applications d'avoir un bout de bois entre les mains après leur lancement. Il faut attendre quelques secondes (quand il n'y a pas de pub) avant de pouvoir appuyer sur la première touche. C'est évidemment rédhibitoire pour une télécommande!

Et pourtant il n'y a aucune raison technique pour que cela dure si longtemps. On peut avec un code code bien pensé, rendre la latence au démarrage de l'application imperceptible par l'utilisateur.

Vous l'aurez compris, l'application Freeteuse ne présente pas tous ces défauts :

- Elle est tout d'abord sans publicité et il n'existe pas de version payante.

- Elle ne nécessite pas d'appariement avec la Freebox.

- Elle ne présente aucune latence au démarrage et est utilisable dès le lancement.

De plus

- Les touches physique V+ et V- du téléphones peuvent servir à contrôler le son.

- Trois touches rapides permettent d'accéder à des fonctions qu'il est difficile d'utiliser habituellement car elles sont enfouies dans des sous menus très peu accessibles :

- Radio

- InfoMusic

- PiP

-

Google Chrome vous avertit en cas de fuite de votre mot de passe

(Génération NT: logiciels)

La mouture 79 de Google Chrome est disponible avec un accent essentiellement mis sur le renforcement de la sécurité.

-

Tutoriel 3D - 2D découpe au laser, le retour du tux

(Journaux LinuxFR)

Sommaire

- Tranche de pingouin

- Au début était le cube

- Il est gros vot manchot ?

- Et si on l’écartelait ?

- Mais quand est-ce qu’on coupe ?

- Et si on l’empalait ?

- On l’empale plus ?

- Parlons peu, parlons kerf

- C’est la lutte finale

- Le petit oiseau va sortir

- TuxOlaser

- Déboitage du tux et montage

- Tadaaaa

- A propos de licences

- Les fichiers

Tranche de pingouin

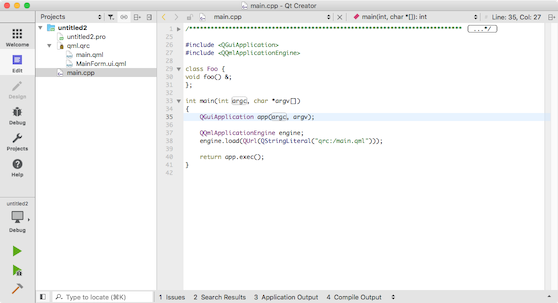

Chose promise, cause perdue. Voici comment transformer un modèle 3D en tranches de bois pour découpe laser. Et en bonus, mon essai initial de découpe en création originale.

Les outils que j’ai utilisé sont blender et inkscape, et ce juste parce que je les connaissais et donc plus facile pour expérimenter.Note aux amateurs de freecad, j’ai commencé à regarder comment ça marche, au cas où ce serait plus simple avec, si jamais je trouve une idée et le courage de refaire un tuto, ça me fera un zeugma.

Au début était le cube

Ouvrir un nouveau fichier dans blender et mettre la scène en métrique, car sinon les mesures ne sont pas fixées par taille réelle. Notez que à chaque étape du tuto on aura des soucis de conversion de dimensions, donc en fait… mais bon faut pas en profiter pour être négligent.

Retirer le cube et ajouter le Tux à la scène. Vous pouvez le trouver ainsi que toutes les licences à Tuuuuuuux

- Faire face au tux (1 au pavé num)

- Mettre la vue iso (5 au pavé num)

- sélectionner le tux

- passer en editor mode (tab)

- Sélectionner le dessous des pattes (B) qui est rond

- Niveler (SZ0)

- sélectionner les deux centres des pattes, (S) Snap cursor to selected

- rebasculer en object mode (tab) , transform origine to 3d cursor (object/transform)

Maintenant, le tux est calé pour avoir le plancher des pattes en comme origine, à la verticale du pseudo centre de gravité que nous venons de choisir.

mettre la bête en Z 0.

Il est gros vot manchot ?

Il nous faut choisir une taille, suffisamment grosse pour que ce soit cool, et pas trop gros pour limiter le prix. Comme l’objet c’est aussi tester une bonne quantité d’épaisseurs pour voir comment ajuster la taille théorique d’une planche par rapport à sa taille réelle (il reste du vide, la colle ça épaissit, les planches sont pas forcément pile à la taille).

Une planche 2mm chez sculpteo (chez qui je teste la découpe laser) fait 94cm*59cm, il faut aussi essayer de rester dans une seule planche avec tous les morceaux. Le tux est presque aussi large que haut, du coup on cherche une approximation de cube découpé en tranches et étalé fait la même surface en gardant un peu de marge. ça fait 55 tranches, donc une hauteur de 116.875mm

Et si on l’écartelait ?

Il nous faut séparer les pattes du corps du tux (ce sont des objets distincts dans le modèle de base en fait et elles s’interconnectent :

Il faut les réunir par booléen union au corps pour avoir un seul objet avec un intérieur/extérieur propre.

On peut maintenant appliquer une subdivision sur le tux CTRL+3, parce que le tux aime la douceur, et pas que celle angevine.

Lui sculpter des yeux plus sympa, parce que même si tout le monde ne veut pas l’avouer, pour avoir l’air cool faut quand même avoir un peu l’air con.

Mais quand est-ce qu’on coupe ?

Patience, il faut regarder un peu avant de couper. Placer un plan plus grand que le tux au sol, genre 20cmx20cm et lui appliquer un booléen d’intersection avec le tux. Et regarder en bougeant le plan sur Z comment seront les tranches.

On voit deux endroits à problème, les ailes et la queue qui auront des tranches avec plus que un morceau, ce qui est plus complexe à coller.

par ex les ailes :

Ce sera lourd à coller ensuite, on peut mais pourquoi…

autant relier les ailes au tronc le plus légèrement possible, avec un lien de 1mm de large.

idem au niveau de la queue :

J’ajoute un bloc en union au niveau de la queue, le plus ajusté possible par un booléen union.

Cela vous permettra de facilement coller, il sera toujours possible de le limer après collage.

Il faut bien nettoyer le résultat de l’union à l’intérieur du tux, ne pas laisser de cloisons internes, c’est à dire éviter d’avoir des plan à l’intérieur des plans :

Finir de nettoyer en retirant les doublons de vertices, boucher les trous, assurer les normales pour que ce soit clair ce qui est à l’intérieur et à l’extérieur.

Et si on l’empalait ?

Pensons au support central qui va nous permettre de facilement positionner et coller les tranches de tux, il va être en trapèze et ressembler à ça au niveau d’une tranche :

Le choix de la découpe sera donc toujours du côté le plus grand, en bas. Donc notre référence pour le positionnement des plans de découpe doit être la face basse de chaque tranche.

Replaçons le plan à 0.01mm en Z (pour éviter le chevauchement parfait des surface avec les pattes Z=0), pensez à remettre tous les éléments avec scale=1 (Ctrl+A scale and rotation) pour la suite.

Faire une array de 50 plans en Z espacés de 2.125mm, faire le booléen intersection avec le tux. Lors de la réalisation de mon bureau réel avec des tux, j’ai constaté que l’empilage de x tranches de 2mm n’a pas un résultat de x*2mm, mais avec l’air restant et la colle environ 2.125. Je vais affiner avec ce tux cette estimation mais déjà on part de 2.125mm par tranche.

On voit les tranches et on voit des petits problèmes

Une tranche qui manque en haut et le cul qui a une mini tranche en bas.

Diminuer le overlap thresold du booléen pour que le problème du haut disparaisse :

Remonter le point du bas du tux pour supprimer le second problème et non, ce n'est pas lui mettre un doigt dans le cul car ça ne doit pas rentrer :

Nickel !

Simulons une épaisseur des tranches pour avoir un aperçu du résultat réel, ajoutons au plan un modifier solidify 2mm avec l’offfet à +1 (vers le haut) pour suivre le plan d’avoir la face basse comme référence :

Le résultat est conforme, retirez le solidify, il ne doit pas interférer avec l’étape de création du lien central.

On l’empale plus ?

Mais si, mais si. En fait ce n’est pas obligatoire, mais ça facilite le positionnement des étages, et on peut aussi le garde sans le coller. Le lien central doit avoir une forme de trapèze et être parfaitement vertical, car pour l’instant sculpteo ne fait pas de découpe oblique.

Il doit faire une épaisseur égale à celle du bois. Pour mon exemple je suis resté sur mon approximation (2.125mm) mais normalement il faut prendre 2mm et ajuster avec l’épaisseur du kerf qui est la taille du laser laissant un vide de découpe autour du trait de coupe. En pratique lors de mon premier essai j’ai eu des soucis d’épaisseur et j’ai du poncer mon trapèze. Du coup comme ce n’est pas nécessaire d’ajuster. Je surestime cette fois-ci la taille du trapèze.

Il faut ajuster sa position pour qu’il traverse tout le tux, coup de chance c’est possible sur ce modèle en plaçant la traverse au centre de la dernière tranche du tux. Mais sinon on l’aurait simplement fait avec deux trapèzes sur deux hauteurs.

Ajustez la taille en X et la hauteur de la partie haute pour faire joli, elle va dépasser un peu et même arrondir sa tête (note postérieure en pratique le trapèze sera toujours trop court, il faut juger les tranches encore un peu plus grand que 2.125mm).

En dessous ajuster aussi la taille en X pour donner un beau trapèze

On voit que c’est moche au niveau du pied

On va donc remodeler un peu le trapèze pour qu’il soit plus joli à cet endroit.

Parlons peu, parlons kerf

Le kerf c’est la partie du bois éliminée par le laser, en pratique la découpe est plus petite que le plan car le laser à une taille non ponctuelle. la découpe de la traverse dans les tranches sera donc un peu plus grande que prévu, et la traverse découpée plus court aussi que prévu.

Dans ce modèle, on peut ignorer le kerf et accepter les différences, elles seront minimes et les pièces collées seront bien ajustées.

appliquons donc le booléen différence entre le plan des tranches et la traverse

Le résultat est difficile à voir mais en vue fil de fer c’est visible

C’est la lutte finale

On peut passer à la phase finale, on réalise les “modifier” sur les planches, puis on aplati le trapèze en retirant les vertices d’un côté.

En mode éditeur, on sépare toutes les tranches (P+loose parts en mode édition) et on les étale dans le bon ordre en vue du dessus. Attention, les numéros générés lors de la réalisation de l’array ne sont pas forcément dans l’ordre de Z…

Pour ne pas me planter, je me met dans une vue adaptée et je bouge une par une les tranches avec des gx0.1 … Je vérifie bien que tout est dans l’ordre puis je met tout le monde à plat (sélectionner tout A puis SZ0)Nous allons avoir des soucis de conversion de taille entre blender puis Inkscape puis sculpteo… on commence par poser un étalon dans blender, un plan au sol de 1cm sur 90cm

Le petit oiseau va sortir

Enfin presque, il faut encore à faire la photo !

Il existe une option de rendering qui génère du svg.

Mettons la caméra au dessus en mode orthographique, d’abord une résolution 100% sur un ratio approximatif de mon rectangle incluant tout.

puis placer la caméra assez bien au dessus de la scène et changez les paramètres :

L’échelle orthographique est ce qui correspond au zoom, ajustez la valeur pour que tout rentre au plus juste

Tout doit rentrer dans la fenêtre de rendering :

Maintenant depuis les user pref, activez le svg freestyle exporter :

Et activez les deux options freestyle et svg export depuis les options rendering

Pressez F12, une image svg sera générée dans le répertoire indiqué dans output nommé 0001.svg,Ouvrez le dans Inkscape, dégroupez et sélectionnez l’étalon. mettez lui une épaisseur de contour à 0 pour ne pas fausser la taille et regardez sa taille. Dans mon cas je tombe sur 35.719cm.

Je vais donc changer la résolution de l’image pour ajuster la taille d’un facteur de 90/35.719=2.52

Je change dans blender le render pour :

Re F12 et vérification.

Mon étalon fait maintenant 1cm sur 90.01cm.

aller, on essaie avec un pixel de moins en Y :), on tombe sur 89.987. C’est moins bon, retour en arrière.Maintenant que l’on a les bonnes tailles dans Inkscape, il faut nettoyer. Parce que le freestyle a introduit des pixels de temps en temps.

Je prends donc chaque découpe pour la repositionner au mieux et aussi supprimer les traces.

Pour m’aider et aussi servir d’étalon entre Inkscape et sculpteo je place un cadre dans une autre couleur qui délimite ma sélection, 53.5cm de large sur 75cm de haut.

Et je fais tout rentrer dedans.

Je vérifie chaque pièce pour assurer qu’il n’y a pas de défaut, et j’assure les contours à 1px et mon cadre avec une couleur différente

C’est prêt.

Pour ceux qui sont plus observateurs que moi, vous verrez que j’ai oublié de grouper une fente dans une tranche. Moi je vais le voir au montage plus tard…TuxOlaser

J’upload chez sculpteo.

Deux couleurs sont détectées, l"une correspond au noir et l’autre au rouge du cadre. Les mesures n’ont pas été conservées, je ne sais pas pourquoi… mais mon cadre me permet de choisir un ajustement de taille à 26.5% qui me redonne les bonnes dimensions.Je peux alors désactiver le cadre rouge dans sculpteo (style 2 sur aucun et voila !

prêt à couper.Livraison comprise il vous en coûtera 53.33€.

Pour info, les tux du bureau ont coûté moins cher, ils étaient en une seule livraison et un peu plus petits, 72€ les 3.Déboitage du tux et montage

Je hais les video de unboxing, et me voilà moi même à déboiter…

Bon, puisqu’il faut :

la boite est bien protégée

et la planche dans la mousse

Les pièces sont tenues par du scotch, il faudra faire attention en retirant le scotch de ne pas casser les pièces fragiles.

Je numérote mes pièces avant de défaire, c’est moins cher que de faire des numéros au laser.

Ensuite on empile jusqu’à la fameuse pièce 33 qu’il faudra redécouper.

Tadaaaa

A propos de licences

J’ai fouillé pour trouver les licences attachées au modèle de base, les voici :

https://opengameart.org/content/tux

https://opengameart.org/sites/default/files/license_images/gpl.png

http://www.gnu.org/licenses/gpl-3.0.html

https://opengameart.org/sites/default/files/license_images/cc-by.png

http://creativecommons.org/licenses/by/3.0/Les fichiers

Voila les fichiers sources blender et le inkscape (piece 33 corrigée)

fichier blender

fichier svgCommentaires : voir le flux atom ouvrir dans le navigateur

-

Lister rapidement les liens d'une page web

(Journaux LinuxFR)

Il y a quelques jours je suis tombé sur une page web cul-de-sac. Pas un rongeur pour se la rat-comté.

J'ai donc tenté une inspection du HTML pour tenter d'y voir plus clair, et là j'me suis dit qu'une petite formule de JavaScript me donnerait une réponse limpide quant à la présence de lien dans la page :

javascript:document.querySelectorAll('a').forEach(console.log)J'ai ajouté la formule à mon http://www.grimoire-command.es/post/2018/List-web-page-links-in-Firefox

-

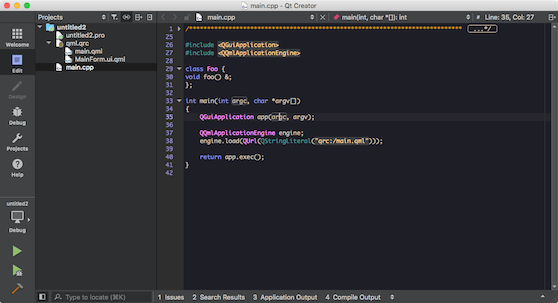

Sortie de Cutelyst 1.3, le framework Web pour Qt gère maintenant le protocole FastCGI et améliore fortement sa performance

(Développez.com)

Sortie de Cutelyst 1.3

le framework Web pour Qt gère maintenant le protocole FastCGI et améliore fortement sa performance

Cutelyst est un framework Web qui se base sur Qt en C++. Ses concepts sont très proches de ceux utilisés par Qt pour les interfaces graphiques, mais du côté Web. La version 1.3 apporte deux améliorations importantes. La première concerne la validation des entrées : adresse électronique, adresse IP, fichier JSON, date, etc. Les validateurs utilisés peuvent être partagées...

-

Falkon 3 le nouveau navigateur pour KDE

(Dépêches LinuxFR)

Vous souvenez‐vous de Qupzilla, petit projet commencé par le tout jeune David Rosca pour apprendre Qt, puis devenu un excellent navigateur WebKit ? En juillet 2017, pendant la réunion annuelle du projet KDE, l’Akademy, David Faure a proposé de remplacer Konqueror par Qupzilla.

Après quelques mois d’incubation, le bébé sort des éprouvettes : Falkon 3.01 est disponible depuis le 8 mai 2018. C’est un navigateur moderne, dont les onglets tournent dans des processus séparés, en utilisant QtWebEngine, lui‐même basé sur Chromium pour le rendu.

Il n’y a pas de grosses différences avec la dernière version de Qupzilla 2.2.6, c’est essentiellement une transposition vers le système de construction de KDE. Il faut bien commencer.- lien n°1 : Falkon.org

- lien n°2 : Qupzilla

- lien n°3 : L’annonce de la mutation

- lien n°4 : Journal des modifications

Les utilisateurs de Konqueror seront en terrain familier pour la partie Web et le menu de configuration, en revanche la navigation de fichiers n’est pas encore intégrée. Il faut bien commencer (bis).

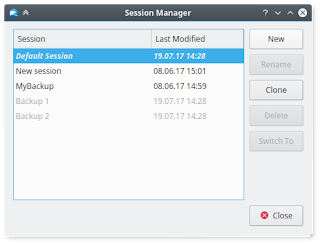

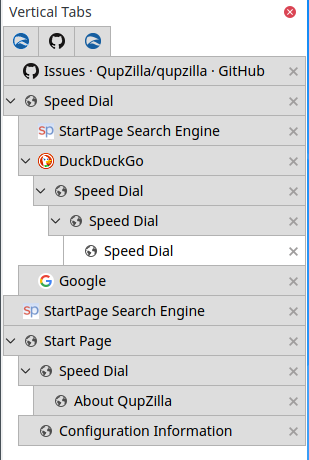

Falkon protège bien votre vie privée (gestion des Cookies, de JavaScript, de HTML 5, Do Not Track), vous propose un greffon Flash (Pepper Flash), plusieurs moteurs de recherche (Duck Duck Go par défaut), un gestionnaire de sessions, des onglets avec indicateurs, un traducteur de pages Web, un validateur de code, des thèmes, une page « Speed Dial » facile à gérer, retrouve le contenu du formulaire quand on fait « précédent » — je reprends ma respiration, regardez les images :

Les indicateurs (cliquables) sur les onglets :

Le (très pratique) gestionnaire de sessions :

Le (sympathique) menu déroulant « clic droit » :

Et comme il est jeune et crashe un peu, Falkon recharge automatiquement tous les onglets ouverts. À ce stade, vous le constatez sans doute, c’est dans l’esprit de KDE : un mélange de simplicité et de « super‐pouvoirs » à portée de configuration.

Quelques extensions disponibles :

- AdBlock, (San Ku Kaï c’est la bataille) contre les pubs ;

- KWallet Passwords, un portefeuille pour les gérer tous ;

- Vertical Tabs, les onglets bien dégagés sur les oreilles ;

- AutoScroll, pour les claustros qui craignent les ascenseurs ;

- Flash Cookie Manager, protège plus que plus la vie privée ;

- GreaseMonkey, soyez le maîîîître du navigateur (scripts dispos sur http://openuserjs.org/) ;

- ImageFinder, qui recherche par l’image, par l’image trouvera ;

- Mouse Gesture, pour les souriceaux maniaques ;

- PIM, pour jouer dans les formulaires ;

- StatusBar Icons, oh que c’est zouli ces petites friandises là en bas !

- Tab Manager, « Onglets ! Au rapport ! »

Les WebExtensions qui sont déjà gérées par Chrome/Chromium, Firefox, Edge et Opera ont encore un long chemin à parcourir.

L’extension ImageFinder en menu déroulant :

L’extension Vertical Tabs en mode hiérarchique :

D’ores et déjà, Falkon est un navigateur à mon goût : avec toutes les extensions, plusieurs onglets et trois fenêtres ouvertes, il tourne comme un charme sans charger le système ; je n’ai pas de problème sur les sites Web, ou alors tellement mineurs que je fais avec.

Falkon est disponible pour GNU/Linux dans vos distributions et aussi en AppImage et Flatpak (via le dépôt KDE), sous Windows (à partir de Win 7) et macOS (à venir).

Commentaires : voir le flux atom ouvrir dans le navigateur

-

Le Bépo en console inclus de base sous GNU/Linux

(Dépêches LinuxFR)

La disposition de clavier Bépo est une disposition de clavier libre (CC-BY-SA et GFDL) optimisée pour le français (inspirée du Dvorak). Elle dispose de tous les symboles nécessaires à toi qui as le petit doigt typographique sur la couture (insécable fine) du pantalon [1]. De plus, les symboles ont été placés de façon logique pour faciliter la frappe et la mémorisation.

Le Bépo permet aussi de taper plus efficacement dans les autres langues latines du fait de leur similitudes (au niveau des fréquences de caractères et de digrammes). Enfin, le Bépo possède de nombreux caractères et touches mortes, qui permettent d’écrire dans toutes les langues européennes, l’Espéranto et plus.

Bref, cela faisait un bon moment que le Bépo avait atteint

la perfectionsa version finale (en tout cas pour le moment :p), et cela fait un moment qu’il a été intégré à X.org (par le biais du projet xkeyboard-config), si bien que même de vieilles RHEL possèdent la disposition.Il était déjà possible d’avoir le Bépo en console dans Debian et Ubuntu (grâce à

console-setup, logiciel permettant d’utiliser les dispositions de clavier de X.org). Il était aussi possible d’installer des paquets spécifiques sous Arch Linux et Gentoo. Pour les autres, installation manuelle obligatoire.Dans tous les cas, si vous n’utilisiez pas Debian ou Ubuntu, vous étiez bon pour l’azerty avant d’installer le Bépo. Et croyez-moi, si un apprentissage du Bépo à l’aveugle permet de taper sur n’importe quel clavier, trouver les touches azerty sur un clavier marqué Bépo, c’est, comment dire…

Bref, personne n’avait entrepris de contacter les développeurs du projet kbd (logiciel qui s’occupe de la gestion du clavier en l’absence de session graphique sous GNU/Linux).

Défi accepté.

[1] NdA : cette blague est une honteuse manœuvre de censure des contributeurs pour remplacer mon appel au typo-nazisme. En plus elle n’est pas drôle.

- lien n°1 : Site officiel de la disposition Bépo

- lien n°2 : Annonce de la sortie de kbd 2.0.0

- lien n°3 : Annonce de la sortie de kbd 2.0.1

Sommaire

- L’histoire ; que dis-je, l’épopée

- Quand est-ce que ça arrive chez moi ?

- Configuration du Bépo avec kbd 2.0.1

- Et pour les autres systèmes d’exploitation ?

- Conclusion

L’histoire ; que dis-je, l’épopée

Il y a très très très longtemps

Le Bépo a longtemps été disponible en console par le biais d’un fichier à installer en tant que super-utilisateur. Il s’agit d’une archive contenant deux fichiers : fr-dvorak-bepo-utf8.map et fr-dvorak-bepo.map. Il faut savoir que le nom a été choisi il y a longtemps, quand le site bepo.fr était encore clavier-dvorak.org et que l’UTF-8 n’était pas encore très répandu…

Mais en bon enquiquineur GNU/Linuxiens que nous sommes, il fallait bien qu’on se plaigne de ne pas pouvoir installer le Bépo par le biais des, ô combien magnifiques et vénérables dépôts de notre distribution chérie.

L’élément perturbateur

Après avoir présenté le Bépo au mainteneur principal de kbd (Alexey Gladkov — rendons à César ce qui appartient à César), il a gentiment accepté de l’introduire au sein du projet. J’ai donc attendu la sortie de la version suivante de kbd. On notera au passage un saut de la version 1.15 à la version 2.0.0, qui consiste en du nettoyage de code et du réusinage — tâche pas forcément intéressante mais dont l’utilité peut être facilement sous-estimée.

Je me suis alors rendu compte que le mainteneur avait renommé les fichiers en dvorak-fr-bepo-utf8.map et dvorak-fr-bepo.map. Ça n’était pas du tout ce que nous souhaitions, car nous ne voulons pas être confondu avec le dvorak-fr ; d’autre part, nous avons réfléchi à un nommage

moins pourriplus simple (si on doit demander le renommage, autant donner un nom sympa une bonne fois pour toute).Fin heureuse

J’ai donc recontacté le mainteneur, et les fichiers ont été à nouveau renommés : ce sont désormais les fichiers fr-bepo.map et fr-bepo-latin9.map, disponible dans la toute fraiche version 2.0.1 de kbd.

Quand est-ce que ça arrive chez moi ?

Pour le moment, ça vient tout juste d’arriver dans Arch Linux (♥) et ça devrait vite arriver dans Gentoo (déjà disponible en ~arch). Pour les autres, il va falloir être patient, car quasiment toutes les autres distributions sont encore à kbd 1.15 (même Frugalware, d’habitude plutôt prompte à intégrer des nouveautés).

Configuration du Bépo avec kbd 2.0.1

Temporairement

Il suffit d’utiliser l’utilitaire

loadkeys:loadkeys fr-bepoDéfinitivement

- Si vous êtes sous Debian ou Ubuntu et que vous ne souhaitez pas utiliser la méthode

console-setup(normalement mise en place automatiquement à l’installation), il suffit de déclarer dans le fichier/etc/default/keyboard:

KEYMAP=fr-bepoSi votre distribution

fait le caféutilise systemd (quasiment toutes sauf Ubuntu, Debian, Gentoo et Slackware), c’est la même procédure mais dans le fichier/etc/vconsole.conf. vous pouvez aussi suivre la méthode Lennart et utiliser localectl qui vient de systemd (What else?).Sous Gentoo, tout comme pour les autres dispositions, la configuration se fait grâce au fichier

/etc/conf.d/keymaps.Sous Slackware, c’est plus

compliquésimple, il faut placer le script ci-dessous dans/etc/rc.d/rc.keymap:

#!/bin/sh if [ -x /usr/bin/loadkeys ]; then /usr/bin/loadkeys fr-bepo.map fiEt pour les autres systèmes d’exploitation ?

Il est de bonne guerre de rappeler que le Bépo est disponible sur beaucoup d’autres plateformes :

Pour X.org, c’est inclut de base depuis longtemps.

Par contre, quand il s’agit de la console, la méthode d’installation « à la main » est toujours de vigueur pour FreeBSD, OpenBSD/NetBSD, OpenIndiana et Minix.

Pour Haiku, ça a été indiqué il y a un moment et il parait que c’est déjà inclus (cherchez « Bépo » dans le texte) mais visiblement personne n’a pris la peine de le documenter sur le wiki. Pour Manux, je suppose que c’est kbd qui est utilisé donc il devrait être possible d’utiliser le Bépo. Quant à GNU/HURD, il semblerait que ça ne soit pas possible, même avec l’outil

console-setupsous Debian GNU/HURD.Si vous avez un ordiphone, ne paniquez pas: vous pouvez avoir le Bépo sur les claviers virtuels Android (application AnySoftKeyboard) et sur iPhone débridé (utilisation du Bépo avec le clavier de base, configuration d’utilisateur non-officielle).

Ah, j’ai failli oublier : il est aussi possible d’installer le Bépo pour Grub 2. Attention néanmoins, c’est uniquement disponible sous Debian, Ubuntu et dérivées,

ckbcompfaisant partie de ce (décidémment ubiquitaire)console-setup(toutefois rien d’impossible si vous savez récupérer un .deb sur packages.debian.org, le décompresser et lancer le bon exécutable). Si vous utilisez Syslinux, vous pouvez aussi avoir un clavier Bépopartieldégradé !Enfin, les pauvres hères enchaînés à un système

privateurpropriétairenon libre, par choix ou par obligation, ont aussi la possibilité de profiter de cette révolution ergonomique. Ici pour MS Windows et là pour Mac OS X. Malheureusement nous n’avons pas réussi à corriger les bogues de Windows.Notons que le système d’exploitation Emacs n’est pas encore pris en charge (si quelqu’un a des compétences de création de dispositions de clavier en Emacs Lisp : contactez-nous !), non plus que GNOME OS (ils ont supprimé la possibilité d’avoir un clavier, mais on bosse sur une extension GNOME Shell).

Conclusion

Vous n’avez plus de raison de rester du côté obscur du clavier !

Ah sinon au départ on voulait forker kbd, mais le git de Serge est tombé en panne, et bien sûr Serge bah il était pas là. Et Michel il fait le con toute la nuit.

La conclusion s’imposait d’elle-même… Vous n’avez quand même pas cru que j’allais me taper le boulot non plus ?!

Petit défi : ne pas utiliser de mots anglais dans les commentaires.

-

Les interfaces tablettes

(Journaux LinuxFR)

Encore un journal de mécontent. Mais avec une solution, ou du moins un contournement.

Je suis un client plutôt satisfait de Boursorama Banque. Bon, tout n'est pas parfait, mais grosso modo, ça va. Et là, il y a une nouvelle interface web. Je l'avais essayé quand elle était encore en déploiement, et j'avais remonté des problèmes. Bien sûr, personne n'écoute, ils ont leur cahier des charges. Mais depuis quelques jours, cette interface est devenu obligatoire. Résultat direct : sur mon écran 1280x1024, je ne vois que 4 transactions sans faire défiler la page. Quand je veux faire un virement, je ne vois pas les comptes externes sans faire défiler, et après, je n'affiche que 9 destinataires à la fois seulement. C'est tellement aéré que c'est la maison des courants d'air.

Et puis j'ai compris. C'est une interface pour tablette. Pour les gros feignants vautrés dans le canapé qui tapotent avec leurs doigts grassouillets, et donc pas précis.

Je me suis lancé dans une CSS de hack, qui résout mon problème. Je partage : https://userstyles.org/styles/125628/boursorama-i-am-not-a-tablet

Maintenant, j'affiche plus de 19 transactions bancaires sans faire défiler. Et sur la page des virements, j'ai les 33 destinataires tous visibles en même temps. Je suis content de moi, parce que j'ai atteint mon but. Je ne suis pas content parce que j'ai du passer du temps à faire ce hack, et maintenant, mon Firefox a une extension de plus installée. Mais c'était ça ou se prendre le chou à chaque fois…

Oui, weboob n'est pas encore à jour. J'irai ptêt les aider si je suis motivé d'ailleurs

-

Huit milliards de vidéos vues par joue sur Facebook, dont la majorité seraient volées !

(Journaux LinuxFR)

Il y a quelques jours, Facebook a fièrement annoncé réaliser plus de huit milliards de vidéos vues par jour ! Un chiffre impressionnant.

Cependant, d'’après cette cette vidéo How Facebook is Stealing Billions of Views , réalisée par un studio allemand Kurzgesagt, 725 de ces vidéos sur 1 000 seraient des vidéos volées sur YouTube par des sites et des regroupeurs de contenus. Ces vidéos deviendraient virales sur Facebook à cause d'un algorithme favorisant les liens sur Facebook plutôt que les liens YouTube, afin que les internautes soient retenus le plus longtemps possible sur Facebook. Facebook tricherait également sur le nombre de vues, puisqu'une dès qu'une vidéo est lue trois secondes sur Facebook elle est comptabilisée. En couplant ce fait à la lecture automatique des vidéos cela gonflerait énormément le nombre de vues. Une vidéo volée sur Facebook serait également mille fois plus vue que sur Youtube, pénalisant ainsi les auteurs indépendants qui se plaignent de la difficulté de rapporter à Facebook les violations des droits d'auteur.

À lire :

- Facebook accusé de voler des milliards de vues sur ses vidéos

- Les 8 milliards de vidéos vues chaque jour sur Facebook relèvent-elles du vol ? -

Toulouse Hacking Convention : 9 mars 2018

(Dépêches LinuxFR)

Le 9 mars 2018, l’ENSEEIHT de Toulouse accueillera la seconde édition de la Toulouse Hacking Convention.

Il s’agit d’une journée de conférences tournant autour de la sécurité, suivie par une soirée/nuit de capture du drapeau (Capture The Flag ou CtF) constituée d’épreuves dans de multiples domaines (cryptographie, ingénierie inverse, exploitation de vulnérabilités, failles Web…). Le tout dans une ambiance conviviale et avec des membres de la communauté du Libre. :)

Il s’agit de la seconde édition, la première ayant été un franc succès puisque nous avons accueilli autour de 150 participants aux conférences, et 80 participants au CTF.

Les conférences de l’année dernière allaient de la rétro‐ingénierie de puces en regardant leurs transistors, à la désobfuscation automatique de code, en passant par un jeu de rôle de sensibilisation à la sécurité informatique. Les vidéos sont d’ailleurs disponibles sur YouTube.

Inscrivez‐vous rapidement, les inscriptions vont fermer d’ici peu !

Le programme de cette année n’est, à ce jour, pas finalisé ; mais il sera annoncé sous peu. Vous pouvez déjà trouver une première version sur le site.

- lien n°1 : Site de l’édition 2018

- lien n°2 : Billetterie

- lien n°3 : Twitter officiel

-

France Culture: que reste-t-il du logiciel libre ?

(Journaux LinuxFR)

Bon jour Nal !

L'émission Du grain à moudre d'hier, sur France Culture, posait cette question: « Que reste-t-il du logiciel libre ». Des représentants de Framasoft et de Microsoft tentaient de répondre à la question. On peut écouter l'émission en podcast.

J'écoutais vaguement en faisant la cuisine… J'en ai néanmoins déduit une conclusion:

- Le modèle économique du logiciel libre, qui consiste à vendre un service plutôt que le logiciel l'a emporté. C'est du moins le modèle économique que le représentant de Microsoft considère dorénavant le plus viable.

- Le logiciel libre, entendu comme 4 libertés, prospère dans les piles logicielles éloignées de l'utilisateur final, mais peine à s'imposer dans les logiciels plus proches de l'utilisateur final.

- L'éthique que certains (dont moi) associent au logiciel libre, de maîtrise de son outil de travail ou de ses données perd du terrain. Non seulement parce que le modèle du service (dans les nuages) s'est imposé, mais aussi parce que d'une manière générale, plus l'on s'approche de l'utilisateur final, moins on trouve de logiciel libre.

Commentaires : voir le flux atom ouvrir dans le navigateur

-

Un logiciel libre de gestion des cultures OpenJardin

(Dépêches LinuxFR)

OpenJardin est un logiciel pour GNU/Linux orienté permaculture. Nous avons réalisé un logiciel de gestion graphique et interactif des parcelles avec des fiches de cultures par parcelle, une planification annuelle et une planification des rotations de cultures.

L’ensemble est géré par une base de données SQLite qui inclut la majorité des espèces potagères et conservera l’historique des cultures. Les variétés potagères seront ajoutées avec la possibilité d’y indiquer les dates de semis et récoltes, les plantes compagnes et les rotations.

Le plan du jardin est facilement modifiable avec intégration d'un fond de plan aux formats JPEG/PNG/BMP, etc. Le logiciel est libre et sous licence GNU GPL v3.0 , il est téléchargeable en paquet Debian

.debpour GNU/Linux 64 bits. On y trouve également une notice d’utilisation à la page téléchargement ainsi que les sources en C++/Qt 5.5, pour ceux qui veulent les modifier. Les retours sont les bienvenus pour l’améliorer ou y apporter des ajouts.

- lien n°1 : Le site OpenJardin

- lien n°2 : La page des téléchargements

- lien n°3 : La notice d’utilisation en PDF

-

Rumeurs sur l'hyper-threading - TLBleed

(Journaux LinuxFR)

La peinture de la dépêche sur la faille Lazy FPU save restore n'étais pas encore sèche

que je tombais sur de curieux messages conseillant de désactiver l'Hyper-threading.Suivis de conversations plus ou moins inquiétantes sur Twitter et dans les mailings list.

Accroche toi au pinceau

Un commit sur OpenBSD désactive l' Hyper-treading par défaut.

Le message associé est explicite:« Since many modern machines no longer provide the ability to disable Hyper-threading in

the BIOS setup, provide a way to disable the use of additional

processor threads in our scheduler. And since we suspect there are

serious risks, we disable them by default »

Puisque les machines récentes ne donnent plus la possibilité de désactiver l' Hyper-threading depuis le BIOS, trouvez un moyen de désactiver l'utilisation des threads d'un processeur dans notre ordonnanceur.

Et comme on suspecte que le risque est sérieux, désactivons le par défaut.Pour faire plus court, j'avais lu auparavant un laconique:

ps deactivate Hyper-threading on your server

Désactivez l'Hyper-threading sur vos serveurs !Venant des équipes OpenBSD, il y a de quoi s'interroger.

J'enlève l'échelle

La conférence Black Hat qui se déroulera en août prochain, propose au menu:

« This therefore bypasses several proposed CPU cache side-channel protections. Our TLBleed exploit successfully leaks a 256-bit EdDSA key from libgcrypt (used in e.g. GPG) with a

98% success rate after just a single observation of signing operation on a co-resident hyperthread and just 17 seconds of analysis time »

En outre, ceci court-circuite plusieurs protections sur le cache. Notre exploit TLBeed a réussi à voler une clef 256-bit EdDSA depuis ligcrypt (utilisée par GPG ) dans 98% des tentatives, après une simple observation des opérations de signature depuis un thread tournant sur le même CPU en seulement 17 secondes d'analyse.- sans oublier le petit message de remerciement du sieur de Raadt.

Colin Percival, auteur en 2005 de:

- un papier sur les attaques via les caches, Cache Missing for Fun and Profit

- un article qui cible plus particulièrement les risques liés à l'Hyper-threading

en remet une couche:

« I think it's worth mentioning that one of the big lessons from 2005 is that side channel attacks become much easier if you're executing on the same core as your victim »

Je pense qu'il est bon de rappeler cette grande leçon de 2005: une attaque enside channelest tellement plus facile si vous l'exécutez sur le même cœur que votre victime.Cuisine

Intel n'est jamais clairement impliqué; mais je précise, comme ça, en passant, que l'Hyper-Threading est une implémentation Intel du Simultaneous Multi Threading.

Il s'agit de faire exécuter en parallèle, sur un même cœur, plusieurs unités fonctionnelles ou de calcul.

Et pour rendre cette technique efficace et moins gourmande en ressource, cette implémentation partage aussi les caches mémoires.Keep systems protected, efficient, and manageable while minimizing impact on productivity

Conclusion

Toutes les solutions de sécurité aujourd’hui ne sont que des châteaux forts construit sur du sable.

Si encore une fois, la désactivation de l'Hyper-threading pourrait même avoir des effets positifs sur les performances, autant en finir une fois pour toute.

Retour aux origines:

- un partage complet sans protection des ressources

- plus de mode protégé

- pas même de segmentation mémoire

Vos machines iront encore plus vite. Enfin, j'espère.

Commentaires : voir le flux atom ouvrir dans le navigateur

-

Retour sur la licence de NumWorks

(Journaux LinuxFR)

À la suite du journal précédent, je me demandais, quelle était la protection effective de la licence CC-BY-NC-SA. J'aimerais bien que l'on ne reprenne pas la guerre libre pas libre de l'autre dépêche, j'ai plutôt envie de voir ce qu'ils apportent, plutôt que de réfléchir à ce dont ils nous privent.

Pour rappel, la licence CC-BY-NC-SA permet de :

- Partager — copier, distribuer et communiquer le matériel par tous moyens et sous tous formats

- Adapter — remixer, transformer et créer à partir du matériel

L'Offrant ne peut retirer les autorisations concédées par la licence tant que vous appliquez les termes de cette licence.

Attribution — Vous devez créditer l'Œuvre, intégrer un lien vers la licence et indiquer si des modifications ont été effectuées à l'Oeuvre. Vous devez indiquer ces informations par tous les moyens raisonnables, sans toutefois suggérer que l'Offrant vous soutient ou soutient la façon dont vous avez utilisé son Oeuvre.

Pas d’Utilisation Commerciale — Vous n'êtes pas autorisé à faire un usage commercial de cette Oeuvre, tout ou partie du matériel la composant.

Partage dans les Mêmes Conditions — Dans le cas où vous effectuez un remix, que vous transformez, ou créez à partir du matériel composant l'Oeuvre originale, vous devez diffuser l'Oeuvre modifiée dans les même conditions, c'est à dire avec la même licence avec laquelle l'Oeuvre originale a été diffusée.

Pas de restrictions complémentaires — Vous n'êtes pas autorisé à appliquer des conditions légales ou des mesures techniques qui restreindraient légalement autrui à utiliser l'Oeuvre dans les conditions décrites par la licence.

Les sources de ce système d'exploitation seront toujours disponibles, si l'entreprise décide de changer de licence, elle ne pourra pas revenir sur ce qui existe déjà.

Cela fait donc a minima un excellent objet d'étude d'une solution employant beaucoup de logiciels libres dans sa construction.

Leur parti pris est très intéressant. Ils ont décidé de na pas utiliser d'OS mais de directement coder sur le Cortex-M4, cela permet à leur système de tenir sur 256kB de ram.

Ils ont du recréer tout un environnement, j'imagine que l'investissement en terme de R&D est très important.

Je pense que c'est cet aspect qui rend l'OpenSource (ou libre) difficile. En effet, admettons qu'ils aient mis leur OS et toute la couche applicative en GPL, ils auraient très facilement pu avoir une boite qui récupère tout le code sans apporter aucune amélioration mais en profitant des faibles prélèvements sociaux d'autres pays (Chine par exemple), pour vendre moins cher. De plus il aurait aussi été possible qu'une entreprise ayant plus de capital fasse baisser les coûts par un effet d'échelle, et reprenne le développement en tant qu'acteur majeur. Cela aurait été super pour la diffusion du produit mais aurait mis un coup d'arrêt à leur entreprise.

Le problème est que l'ingénierie logicielle a certes un coût mais les investissements sont majoritairement du salaire alors que le développement d'un matériel entraîne des investissements en prototypes et une industrialisation sur une chaîne de production, qui peut rendre la libre utilisation, des développements précédemment fait, périlleux pour l'entreprise.

Donc oui, à titre personnel, je me questionne sur le fait qu'il existe systématiquement un modèle économique viable libre associable à n'importe quel projet. N'ayant pas la réponse, je serais ravi que l'on m'éclaire sur ce sujet qui dépasse vraiment mon niveau de compétence.

Maintenant, cela montre qu'il est possible d'utiliser des briques libres pour faire une calculatrice, c'est vraiment intéressant.

Quelqu'un a-t-il une idée sur la différence de consommation entre une carte cortex-M4 et une carte raspberry pi zeros ?

Si je trouve leur idée intéressante, je trouve que d'avoir un terminal mobile basé sur une distribution linux minimale avec un environnement de type SageMath avec une version des notebooks Jupyter adaptés aux petits écrans pourrait vraiment être cool ! Quand on voit à quel point des outils tels que JupyterLab permettent de rendre l'accès à des environnements python avec toutes les libs installées, utiliser une raspbian minimale avec un une appli Qt pour le web et un serveur jupyter, permettrait de faire vraiment pas mal de choses ! Sachant qu'en plus Jupyter peut faire plein d'autres choses telles que du SageMath, Octave, maxima, Julia, …

Le problème serait alors l'autonomie … mais bon avec l'arrivée en 2019 de l'advanced color paper display, on pourrait bien avoir accès à une technologie permettant de faire des petits écrans couleurs qui ne consomment pas du tout. Un trois couleurs serait déjà faisable par exemple.

Donc je trouve que leur idée est vraiment top, mais personnellement je préférerais pouvoir conserver mon environnement Linux même sur une calculette. Bon, en même temps, je ne pense vraiment pas être la cible … Cependant je trouve l'analyse d'Aurélien Pierre assez intéressante. Il serait juste sympa d'avoir tout l'environnement dans une machine qui ressemblerait à une TI92 ou une voyage 200, même si ce format n'est plus vraiment d'usage … Avoir un clavier Alpha-numérique physique est tout de même un gros plus. Sachant qu'une calculatrice moderne de chez TI avec des capacités CAS coûte encore 130€, il reste de quoi s'amuser avec les raspberry pi et consort …

Commentaires : voir le flux atom ouvrir dans le navigateur

-

[Énigme] L'escargot et le géant

(Journaux LinuxFR)

Cher Nal' puisque c'est dimanche et qu'il pleut, je me permets de te soumettre l'énigme suivante.

Un petit escargot est posé à l'extrémité d'une corde parfaitement élastique de 100m.

L'escargot souhaite arriver à l'autre bout de la corde. Il se meut à la vitesse d'1m/h.Au début de chaque heure, un géant tire sur la corde et celle-ci s'allonge de façon élastique. À chaque fois la corde s'allonge de 100m de façon homogène.

Donc, à chaque fois que le géant tire sur la corde, la distance à parcourir et la distance parcourue augmentent.

À l'issue de la première heure, l'escargot à parcouru 1m, le géant tire sur la corde, celle-ci passe à 200m. Puisque la déformation est homogène, l'escargot se trouve maintenant à 2m du point de départ.

L'escargot peut-il atteindre le bout de la corde ? Si oui, en combien d'heures ?

La nimage de circonstance.

-

Qt Speech arrive avec Qt 5.8, la synthèse vocale débarque comme préversion technologique, notamment pour aider les personnes en situation de handicap

(Développez.com)

Qt Speech arrive avec Qt 5.8

La synthèse vocale débarque comme préversion technologique, notamment pour aider les personnes en situation de handicap

Parmi les nouveautés de Qt 5.8, on compte Qt Speech, en préversion technologique. Pour le moment, ses fonctionnalités se limitent à la lecture à voix haute d'un texte par un ordinateur, en utilisant les API de chaque système d'exploitation ; ainsi, il sera plus facile d'ouvrir son application aux personnes souffrant de certains handicaps (notamment... -

Agenda du Libre pour la semaine 26 de l'année 2018

(Dépêches LinuxFR)

Calendrier web, regroupant des événements liés au Libre (logiciel, salon, atelier, install party, conférence), annoncés par leurs organisateurs. Voici un récapitulatif de la semaine à venir. Le détail de chacun de ces 30 événements (1 en Belgique, 29 en France, 0 au Luxembourg, 0 au Québec 0 en Suisse et 0 en Tunisie) est en seconde partie de dépêche.

- lien n°1 : April

- lien n°2 : Agenda du Libre (Belgique, France, Luxembourg, Suisse et Tunisie)

- lien n°3 : Carte des événements

- lien n°4 : Proposer un événement

- lien n°5 : Annuaire des organisations

- lien n°6 : Agenda de la semaine précédente

- lien n°7 : Agenda du Libre du Québec

Sommaire

- [FR Nantes] Cycle café vie privée Protection de son trafic sur Internet (VPN) - Le lundi 25 juin 2018 de 18h00 à 21h00.

- [FR Grenoble] Contribuer à BANO, la base d’adresse nationale d’OSM - Le lundi 25 juin 2018 de 18h30 à 20h30.

- [FR Gaillac] Atelier informatique libre - Le lundi 25 juin 2018 de 19h30 à 23h00.

- [FR Marseille] PGDay France - Le mardi 26 juin 2018 de 08h30 à 17h30.

- [FR Aiglun] Après-midi « Open data » et « Cartopartie » - Fête de l'été - Le mardi 26 juin 2018 de 15h00 à 19h00.

- [FR Quetigny] Découvrir, tester, installer Linux et d’autres logiciels libres - Le mardi 26 juin 2018 de 20h30 à 23h30.

- [FR Le Mans] Permanence du mercredi après-midi - Le mercredi 27 juin 2018 de 12h00 à 17h00.

- [FR Rennes] Sécuriser son infrastructure - Le mercredi 27 juin 2018 de 18h30 à 21h00.

- [FR Montpellier] Rencontres des Groupes OpenStreetMap OSM - Le mercredi 27 juin 2018 de 19h00 à 22h00.

- [FR Toulouse] Rencontres Tetalab - Le mercredi 27 juin 2018 de 20h30 à 23h30.

- [FR Choisy-le-Roi] Pas Sage en Seine - Du jeudi 28 juin 2018 à 10h00 au dimanche 1 juillet 2018 à 20h00.

- [FR Rennes] Conseil d’administration de Gulliver - Le jeudi 28 juin 2018 de 12h00 à 14h00.

- [FR Martigues] Permanence du jeudi de l'ULLM - Le jeudi 28 juin 2018 de 16h30 à 18h30.

- [FR Challans] Permanence Linux - Le jeudi 28 juin 2018 de 18h00 à 20h00.

- [FR Bordeaux] Jeudi Giroll - Le jeudi 28 juin 2018 de 18h30 à 20h30.

- [FR Peymeinade] Install-Party GNU/Linux - Le jeudi 28 juin 2018 de 19h00 à 21h00.

- [FR Vesseaux] Projection-débat du film « Nothing to hide » - Le jeudi 28 juin 2018 de 19h00 à 22h00.

- [FR Paris] Soirée de Contribution au Libre - Le jeudi 28 juin 2018 de 19h30 à 22h30.

- [FR Montpellier] Atelier du Libre Ubuntu et Logiciels Libres - Le vendredi 29 juin 2018 de 18h00 à 23h00.

- [FR Paris] Apéro April - Le vendredi 29 juin 2018 de 19h00 à 22h00.

- [FR Dijon] Atelier de création numérique et électronique - Le vendredi 29 juin 2018 de 20h30 à 23h59.

- [FR Saint-Jean-de-Védas] Repair Café - Le samedi 30 juin 2018 de 09h00 à 13h00.

- [FR Casseneuil] Install Partie GNU/Linux - Le samedi 30 juin 2018 de 10h00 à 17h00.

- [FR Wintzenheim] Réunion du Club Linux - Le samedi 30 juin 2018 de 13h00 à 19h00.

- [FR Villefranche-sur-Saône] Repaircafé - Le samedi 30 juin 2018 de 13h30 à 17h30.

- [FR Marseille] Install Party GNU/Linux - Le samedi 30 juin 2018 de 14h00 à 19h00.

- [BE Liège] Linux Install Party - Le samedi 30 juin 2018 de 14h00 à 18h00.

- [FR Ivry sur Seine] Cours de l’Ecole du Logiciel Libre - Le samedi 30 juin 2018 de 14h30 à 18h30.

- [FR Courbevoie] Assemblée Générale annuelle de l'association StarinuX - Le samedi 30 juin 2018 de 14h30 à 17h00.

- [FR Poucharramet] Festival AgitaTerre - Le dimanche 1 juillet 2018 de 09h30 à 23h00.

[FR Nantes] Cycle café vie privée Protection de son trafic sur Internet (VPN) - Le lundi 25 juin 2018 de 18h00 à 21h00.

Protection de son trafic sur Internet

Pourquoi et comment chiffrer son trafic sur Internet avec un VPN (réseau privé virtuel) ?

Présentation du fonctionnement d’un VPN, de son intérêt et de sa mise en place.Au bar associatif La Dérive https://lajavadesbonsenfantsblog.wordpress.com/

- La Dérive, 1 rue du Gué Robert, Nantes, Pays de la Loire, France

- Adresse web https://cafevieprivee-nantes.fr/category/actualites

- Tags café-vie-privée, anonymat, vpn, tunnel

[FR Grenoble] Contribuer à BANO, la base d’adresse nationale d’OSM - Le lundi 25 juin 2018 de 18h30 à 20h30.

Le collectif OpenStreetMap Grenoble vous invite à son prochain atelier OSM, La Base Adresses Nationale Ouverte (BANO) est une initiative d’OpenStreetMap France.

Elle a pour objet la constitution d’une base la plus complète possible de points d’adresse à l’échelle de la France.

L’objectif est de proposer une couverture d’adresses la plus étendue possible et la plus homogène possible.

Cela doit permettre de réaliser sur le plus largement possible des opérations de géocodage (Quelle position correspond à cette adresse) et de géocodage inversé (Quelle adresse correspond à cette position).

Lors de ce mapathon, le collectif OpenStreetMap Grenoble vous propose d’apprendre à contribuer à la BANO.

À partir de 18h30 à La Coop-Infolab. 31 rue Gustave Eiffel – 38 000 Grenoble

BANO ou BAN

La BAN (Base Adresse Nationale) est la base de référence nationale issue d’une convention signée entre l’IGN, le Groupe La Poste, l’État et OpenStreetMap France.

BANO est un projet initié par OpenStreetMap France début 2014 et n’a pas encore intégré de données issues de la BAN (chantier en cours). Le contenu de la BAN est plus complet (plus de 20 millions d’adresses) que BANO (15. 5M d’adresses), mais n’intègre(ra) pas de contributions faites sur OpenStreetMap et encore très peu de données opendata diffusées par certaines collectivités.

C’est quoi OSM

OpenStreetMap (OSM) est un projet international fondé en 2004 dans le but de créer une carte libre du monde.

Nous collectons des données dans le monde entier sur les routes, voies ferrées, les rivières, les forêts, les bâtiments et bien plus encore

Les données cartographiques collectées sont ré-utilisables sous licence libre ODbL (depuis le 12 septembre 2012). Pour plus d’information inscrivez-vous à la liste locale OSM de Grenoble

- La Coop Infolab, 31 rue Gustave Eiffel, Grenoble, Auvergne-Rhône-Alpes, France

- Adresse web https://www.la-coop.net/evenement/atelier-osm-juin18

- Tags osm, openstreetmap, cartographie, atelier

[FR Gaillac] Atelier informatique libre - Le lundi 25 juin 2018 de 19h30 à 23h00.

Un atelier d’informatique libre voit le jour au sein du chinabulle, pour créer un espace temps d’échange autour des solutions informatiques libres.

- Au comptoir du Chinabulle, 47 rue du Chateau du Roi, Gaillac, Occitanie, France

- Adresse web https://www.chinabulle.org

- Tags échange, transmission, logiciels-libres, découverte, chinabulle, atelier

[FR Marseille] PGDay France - Le mardi 26 juin 2018 de 08h30 à 17h30.

Le PGDay France est un moment de rencontres et de conférences pour la communauté francophone de PostgreSQL.

Les conférences s’adressent à tous les utilisateurs du logiciel étudiants, administrateurs systèmes, DBA, développeurs, chefs de Projets, décideurs.

- Théâtre Joliette, 2 place Henri Verneuil, Marseille, Provence-Alpes-Côte d’Azur, France

- Adresse web http://pgday.fr

- Tags postgresqlfr, conference, pgday

[FR Aiglun] Après-midi « Open data » et « Cartopartie » - Fête de l'été - Le mardi 26 juin 2018 de 15h00 à 19h00.

Démarche participative et collaborative, il s’agit notamment de permettre aux associations, producteurs locaux, habitants et usagers de cartographier les services / activités qui constituent la richesse de notre territoire sur un outil libre (Openstreetmap).

Les données publiques communales mises en ligne et la création d’un agenda partagé (à destination des associations) seront également valorisées.

Les organisateurs du marché d’Aiglun proposeront de nombreuses animations à travers la fête l’été. Venez nombreux

Tout l’après-midi marché bio et des producteurs locaux, animation musicale, balades avec les ânes, jeux, atelier de cartographie libre

À 15 h, 16 h et 17 h visite du champ de lavande rendez-vous sur la place du marché

À partir de 17 h dégustations des produits du marché préparés par le restaurant Le Pressoir Gourmand et grillades d’agneau

À 18 h apéritif local offert par la mairie d’Aiglun, débat sur la cartographie et les données ouvertes

- Marché bio et des producteurs locaux d'Aiglun, place Edmond Jugy, Aiglun, Provence-Alpes-Côte d'Azur, France

- Adresse web https://wiki.openstreetmap.org/wiki/Cartopartie_et_opendata_-_aiglun

- Tags openstreetmap, osm, open-data, carto-partie

[FR Quetigny] Découvrir, tester, installer Linux et d’autres logiciels libres - Le mardi 26 juin 2018 de 20h30 à 23h30.

COAGUL est une association d’utilisateurs de logiciels libres et de GNU Linux en particulier.

Nous utilisons toutes sortes de distributions GNU / Linux (Ubuntu, CentOs, Fedora, Debian, Arch…) et toutes sortes de logiciels pourvu qu’ils soient libres (VLC, LibreOffice, Firefox, Thunderbird, GPG, Tor, OpenNebula, LXC, Apache…).

Nous partageons volontiers nos connaissances des logiciels libres et l’entraide est de mise dans nos réunions.

Les permanences servent à se rencontrer et à partager nos expériences et notre savoir sur le logiciel libre.

Vous souhaitez nous rencontrer nous vous accueillerons à notre permanence.

On adore les gâteaux et les chocolats, vous pouvez donc en apporter-)

- Centre Social et Culturel Léo Lagrange, 3 rue des Prairies, Quetigny, Bourgogne-Franche-Comté, France

- Adresse web https://www.coagul.org

- Tags permanence, coagul, logiciels-libres, linux

[FR Le Mans] Permanence du mercredi après-midi - Le mercredi 27 juin 2018 de 12h00 à 17h00.

Assistance technique et démonstration concernant les logiciels libres.

- Centre social, salle 220, 2ᵉ étage, Pôle associatif Coluche, 31 allée Claude Debussy, Le Mans, Pays de la Loire, France

- Adresse web https://linuxmaine.org

- Tags linuxmaine, permanence, assistance

[FR Rennes] Sécuriser son infrastructure - Le mercredi 27 juin 2018 de 18h30 à 21h00.

La sécurité informatique ne repose pas que sur la qualité du code et le chiffrement (même s’ils sont essentiels), c’est aussi une question d’architecture.

Vous (re)découvrirez quelques principes de sécurisation des infrastructures informatiques tels que la séparation des flux, la redondance et d’autres éléments pouvant améliorer la protection et la disponibilité des services.

La conférence sera présentée par

Thomas MICHEL

Esprit Libre

esprit-libre-conseil.com (link is external)mercredi 27 juin - 18h30

FrenchTech Rennes - Saint-Malo

2 rue de la Mabilais

Rennes- FrenchTech Rennes - Saint-Malo, 2 rue de la Mabilais, Rennes, Bretagne, France

- Adresse web https://caplibre.fr/actualites/securiser-son-infrastructure

- Tags caplibre, conférence, sécurité

[FR Montpellier] Rencontres des Groupes OpenStreetMap OSM - Le mercredi 27 juin 2018 de 19h00 à 22h00.

Ces rencontres mensuelles se veulent être des instants conviviaux pour faire un compte-rendu des activités du mois précédent, mais aussi pour présenter les opérations et rendez-vous à venir que proposent les groupes HérOSM et le Collectif des Garrigues. Naturellement, elles sont également ouvertes à tout public.

Si vous avez des propositions n’hésitez pas à compléter la page dédiée.

- En première partie de soirée, une initiation pour les débutants est prévue

- Possibilité d’initiation à la contribution pour les débutants qui le désire

- Préparation du dossier pour le budget de l’Opération Libre

- Préparation de l’Opération Libre à Jacou

- Travail sur les voies manquantes sur (enjeu évident de géocodage d’adresses, comme celles fournies par SIRENE ou FANTOIR par exemple

- Petit topo sur la saisie des noms de rues à partir des données cadastre/fantoir par département

-

Propositions au sujet du calcul d’itinéraire multimodal (auto, vélo, piéton) dans les futures discussions

- La pratique des cartoparties

- Faut-il prioriser la cartographie de certains endroits (gares et arrêts de tram, par exemple) ?

Contributions libres

Nous vous présenterons les projets en cours, nous vous vous proposerons de contribuer, faire de la production de données, puis nous passerons à un instant convivial sur la terrasse.

Comme d’habitude, chacun amène ce qu’il veut à manger et à boire pour un repas partagé.

N’oubliez pas vos ordinateurs portables pour la séance de saisieLe dernier mercredi de chaque mois

Mercredi 27 septembre 2017 de 19h00 à 22h00

Mercredi 25 octobre 2017 de 19h00 à 22h00

Mercredi 29 novembre 2017 de 19h00 à 22h00

Mercredi 20 décembre 2017 de 19h00 à 22h00

Mercredi 24 janvier 2018 de 19h00 à 22h00

Mercredi 28 février 2018 de 19h00 à 22h00

Mercredi 28 mars 2018 de 19h00 à 22h00

Mercredi 25 avril 2018 de 19h00 à 22h00

Mercredi 30 mai 2018 de 19h00 à 22h00

Mercredi 27 juin 2018 de 19h00 à 22h00Mercredi 27 septembre 2017 de 19h00 à 22h00

Le Faubourg - 15, rue du Faubourg de Nîmes, 34 000 MontpellierTramway lignes 1, 2 et 4 arrêt Corum

GPS Latitude 43.614186 | Longitude 3.881404

Carte OpenStreetMapLe dernier mercredi de chaque mois.

- Le Faubourg, 15 rue du Faubourg de Nîmes, Montpellier, Occitanie, France

- Adresse web http://montpel-libre.fr

- Tags osm, openstreetmap, cartographie, donnee, saisie, cartopartie, participative, rencontre, logiciels-libres, montpel-libre

[FR Toulouse] Rencontres Tetalab - Le mercredi 27 juin 2018 de 20h30 à 23h30.

Rencontre hebdomadaire des hackers et artistes libristes Toulousains.

Ouvert au public tous les mercredi soir.

Venez nombreux.

- Mix'Art Myrys, 12 rue Ferdinand Lassalle, Toulouse, Occitanie, France

- Adresse web https://www.tetalab.org

- Tags rencontre, hacker, artistes-libristes, tetalab

[FR Choisy-le-Roi] Pas Sage en Seine - Du jeudi 28 juin 2018 à 10h00 au dimanche 1 juillet 2018 à 20h00.

Le festival auto-organisé par vous et l’équipe de Pas Sage En Seine se tiendra du 28 juin au 1er juillet 2017 à Choisy-le-Roi dans et aux abords de la Médiathèque Louis Aragon.

Nous vous invitons à participer à PSES2018 et venir participer à ses ateliers et conférences bien sûr, mais aussi installations, discussions et autres formes d’interventions.

Des thèmes sont proposés, pas imposés, pour laisser place à la manifestation d’idées originales.

Le Festival sera un moment convivial et festif pour décrire nos modes d’organisation, nos outils, nos perspectives, évoquer les usages d’autodéfense numériques faces aux perpétuelles manipulations sécuritaires.

Le vendredi sera une journée spéciale consacrée au RGPD, et le samedi soir (lors de la micro-nocturne jusqu’à 21h30) vous pourrez assister à un concert de chiptune réalisé par le collectif Chip Bangers.

L’Hacktiviste naît de cette prise de conscience intégrale. Il ouvre, détourne, invente tous les possibles, ou presque… Être et faire politiquement ensemble sera notre prochaine étape

Le trajet depuis le centre de Paris prend une petite vingtaine de minutes uniquement (Gare du RER C Choisy-le-Roi).

- Médiathèque Louis Aragon, 17 rue Pierre Mendès France, Choisy-le-Roi, Île-de-France, France

- Adresse web https://passageenseine.fr

- Tags numérique, hacktivisme, communs, privacy, hacking, white, atelier, conference

[FR Rennes] Conseil d’administration de Gulliver - Le jeudi 28 juin 2018 de 12h00 à 14h00.

Gulliver tiendra son conseil d’administration à la Maison de la Consommation et de l’Environnement (MCE) le jeudi 28 juin 2018 à partir de 12 h. L’ordre du jour est donné dans le lien ci-dessous.

Ce conseil d’administration est ouvert à tous. Toute personne, membre ou non membre de Gulliver, peut y assister (sauf CA exceptionnel signalé à l’avance), voir comment fonctionne notre association et y donner son avis.

La MCE est située 42 bd Magenta à Rennes (plan d’accès). La salle réservée est celle de l’accueil.

- Maison de la Consommation et de l’Environnement, 48 bd Magenta, Rennes, Bretagne, France

- Adresse web http://gulliver.eu.org/conseil_dadministration_juin_2018

- Tags gulliver, conseil-administration

[FR Martigues] Permanence du jeudi de l'ULLM - Le jeudi 28 juin 2018 de 16h30 à 18h30.

Comment utiliser et les Logiciels Libres.

avec l’association des Utilisateurs de Logiciels Libres du Pays de Martégal (ULLM).

28 2018 de 16h30 à 18h30 à la (quai des Anglais).

Entrée Libre. Tout public.

- Médiathèque de Martigues, quai des Anglais, Martigues, Provence-Alpes-Côte d’Azur, France

- Adresse web http://www.ullm.org

- Tags ullm, logiciels-libres, linux, permanence, gnu-linux

[FR Challans] Permanence Linux - Le jeudi 28 juin 2018 de 18h00 à 20h00.

Chaque dernier jeudi du mois, Linux Challans vous donne rendez-vous à l’Albanera Café, 17 rue du Général Leclerc 85 300 Challans.

Nous vous proposons lors de ces rendez-vous mensuels d’échanger autour du Libre, des conseils ou une assistance technique.

Vous pouvez venir pour vous faire aider, ou aider, à installer et paramétrer une distribution GNU/Linux de votre choix ou des logiciels libres sur votre ordinateur.

Recommandations

- Sauvegardez vos données avant de venir.

- Libérez de la place sur le disque dur (20 Go minimum) et défragmentez Windows si vous voulez le conserver.

- Nous prévenir de votre passage via la messagerie.

Vous pouvez aussi venir pour une première prise d’informations et de contacts.

Nous vous attendons toujours plus nombreux

- Albanera Café, 17 rue du Général Leclerc, Challans, Pays de la Loire, France

- Adresse web http://linuxchallans.org

- Tags linux-challans, permanence, rencontre, mensuelle, soirée, logiciels-libres, gnu-linux

[FR Bordeaux] Jeudi Giroll - Le jeudi 28 juin 2018 de 18h30 à 20h30.

Les membres du collectif Giroll, GIROnde Logiciels Libres, se retrouvent une fois par semaine, pour partager leurs savoir-faire et expériences autour des logiciels libres.

Le collectif réalise aussi une webradio mensuelle, tous les second mardis du mois, à retrouver en direct sur le site de Giroll.

Ses rencontres sont ouvertes à tous.

- Centre d’animation Saint Pierre, 4 rue du mulet, Bordeaux, Nouvelle-Aquitaine, France

- Adresse web https://www.giroll.org

- Tags rencontre, install-partie, giroll, webradio, logiciels-libres, rencontre-hebdomadaire

[FR Peymeinade] Install-Party GNU/Linux - Le jeudi 28 juin 2018 de 19h00 à 21h00.

Désormais tous les 4ᵉˢ mercredi du mois, Clic Ordi et Linux Azur vous proposent une install-party ouverte à tous et gratuite.

- Découvrez un monde rempli de Papillons, licornes, mais surtout de manchots

- Plus besoin de se soucier des virus et autres logiciels malveillants.

- Le support de Windows Vista s’arrête dans un an, et les principaux logiciels ont déjà arrêté leurs mise à jour, réagissez

- Ramenez vos ordinateurs obsolètes et donnez leur une seconde vie.

Nous aimerions développer autour de Handy-Linux (et de sa future mouture avec Debian-Facile) afin de répondre à des besoins simples pour des personnes difficiles à former et pouvant se retrouver en fracture numérique).

Nous sommes ouverts à tout, y compris à la bidouille sur l’atelier avec le fer à souder.

Organisé conjointement par http://clic-ordi.com/fr et https://www.linux-azur.org

- Magasin Clic Ordi, 65 avenue de Boutiny, Peymeinade, Provence-Alpes-Côte d’Azur, France

- Adresse web https://www.linux-azur.org/ral/ral-peymeinade-clicordi

- Tags linux-azur, install-party, clic-ordi, bidouille, handy-linux

[FR Vesseaux] Projection-débat du film « Nothing to hide » - Le jeudi 28 juin 2018 de 19h00 à 22h00.

Ouverture des portes à 19h pour partager un moment de convivialité, discuter des choses et d’autres comme les logiciels libres, les données personnelles, la vie privée

Il y a une buvette sur place, et vous pouvez également apporter un plat à partager ou biscuits apéro

La projection du film documentaire Nothing to Hide aura lieu à 20h30, et sera suivie d’un débat pour répondre à vos questions

« Dire que votre droit à la vie privée importe peu, car vous n’avez rien à cacher revient à dire que votre liberté d’expression importe peu, car vous n’avez rien à dire. Car même si vous n’utilisez pas vos droits aujourd’hui, d’autres en ont besoin. Cela revient à dire les autres ne m’intéressent pas », Edward Snowden

Ce documentaire aborde le thème de la vie privée et des données personnelles.

L’entrée est à prix libre (adhésion à l’association Vesseaux-Mère).

- le Vesseaux-Mère, 23 chemin du Prieuré, place de l'Église, Vesseaux, Auvergne-Rhône-Alpes, France

- Adresse web https://ardechelibre.org/projection-debat-du-film-documentaire-nothing-to-hide/

- Tags vie-privée, projection, nothing-to-hide, débat

[FR Paris] Soirée de Contribution au Libre - Le jeudi 28 juin 2018 de 19h30 à 22h30.

Parinux propose aux utilisateurs de logiciels libres de se réunir régulièrement afin de contribuer à des projets libres. En effet, un logiciel libre est souvent porté par une communauté de bénévoles et dépend d’eux pour que le logiciel évolue.

Nous nous réunissons donc tous les dans un environnement propice au travail (pas de facebook, pas de télé, pas de jeux vidéos, pas de zombies).

Vous aurez très probablement besoin d’un ordinateur portable, mais électricité et réseau fournis.

En cas de difficulté, vous pouvez joindre un des responsables de la soirée, Emmanuel Seyman (emmanuel (at) seyman.fr), Paul Marques Mota mota (at) parinux.org, ou Magali Garnero (Bookynette) tresorier (at) parinux.org.

Pour obtenir le code d’entrée de la porte cochère, envoyez un mail au responsable.

On peut amener de quoi se restaurer (Franprix, 8 rue du Chemin Vert, ferme à 22h)

Regazouillez sur Twitter - Wiki des soirées

Programme non exhaustif

- Fedora (sa traduction)

- Parinux, ses bugs et son infrastructure

- April, … y a toujours quelque chose à faire

- Open Food Facts/ Open Beauty Facts, sa base de données, ses contributeurs, sa roadmap

- Schema racktables, son code

- Agenda du Libre, mise à jour et amélioration du code

- Ubuntu-Fr, son orga, ses événements

- En vente libre, maintenance et commandes

- Open street map, une fois par mois

- Linux-Fr sait faire

- en vente libre

- …

tout nouveau projet est le bienvenu.

- FPH, 38 rue Saint-Sabin, Paris, Île-de-France, France

- Adresse web http://www.parinux.org/

- Tags parinux, scl, soirée-de-contribution-au-libre, fph, logiciels-libres

[FR Montpellier] Atelier du Libre Ubuntu et Logiciels Libres - Le vendredi 29 juin 2018 de 18h00 à 23h00.

L’équipe de Montpel’libre vous propose une permanence Logiciels Libres, discussions libres et accompagnements techniques aux systèmes d’exploitation libres, pour vous aider à vous familiariser avec votre système GNU/Linux au quotidien.

Le contenu de l’atelier s’adapte aux problèmes des personnes présentes et permet ainsi l’acquisition de nouvelles compétences au rythme de chacun.

Vous pourrez y aborder plusieurs thèmes

- Discussions conviviales entre utilisateurs autour de Linux en général

- Préinscription aux prochains Cafés Numériques et Install-Party

- Premières explorations du système

- Installations et configurations complémentaires

- Mise à jour et installation de nouveaux logiciels

- Prise en main, découverte et approfondissement du système

Les Ateliers du Libre ont lieu à la Mpt Melina Mercouri de Montpellier, tous les derniers vendredis de chaque mois de 18h00 à 20h00, sauf période de vacances.

Entrée libre et gratuite sur inscription. Une simple adhésion à l’association est possible et auprès de la Mpt.

Cet événement est proposé par le partenariat qui lie la Mpt Melina Mercouri de Montpellier et Montpel’libre.

Toute une équipe de passionnés, vous propose l’animation de l’Atelier du Libre par les membres de Montpel’libre. Permanence Logiciels Libres, discussions libres et accompagnements des utilisateurs aux systèmes exploitation libres, Linux, sur le cyberespace de consultations libres.

En fin de soirée, l’atelier fera progressivement place à un instant très convivial, les RDVL sont des rendez-vous mensuels de discussions sur le thème des logiciels libres, des arts libres, de l’open source et plus généralement de la culture du libre et du numérique.

Cette soirée, très conviviale, se passe autour d’un repas partagé, chacun porte un plat, entrée, spécialité, dessert, boisson… Ordinateurs et réseaux disponibles.

Notre équipe vous attend pour répondre à vos questions et satisfaire votre curiosité.

Maison pour tous Mélina Mercouri 842, rue de la vieille poste, 34 000 Montpellier

Bus ligne 9, La Ronde arrêt Pinville

GPS Latitude 43.61354 Longitude 3.908768

Carte OpenStreetMapRendez-vous mensuel, tous les derniers vendredis, salle jamais le dimanche

- Maison pour tous Mélina Mercouri, 842 rue de la Vieille Poste, Montpellier, Occitanie, France

- Adresse web http://montpel-libre.fr

- Tags atelibre, accompagnement, initiation, gnu-linux, logiciels-libres, montpel-libre, ubuntu

[FR Paris] Apéro April - Le vendredi 29 juin 2018 de 19h00 à 22h00.

Un apéro April consiste à se réunir physiquement afin de se rencontrer, de faire plus ample connaissance, d’échanger, de partager un verre et manger mais aussi de discuter sur le logiciel libre, les libertés informatiques, fondamentales, l’actualité et les actions de l’April…

Un apéro April est ouvert à toute personne qui souhaite venir, membre de l’April ou pas.

N’hésitez pas à venir nous rencontrer.

Où et quand cela se passe-t-il

L’apéro parisien aura lieu vendredi 29 juin 2018 à partir de 19h00 dans les locaux de l’April.

L’adresse

April, 44/46 rue de l’Ouest, bâtiment 8, 75 014 Paris (entrée possible par la place de la Catalogne, à gauche de la Biocoop, au niveau des Autolib).

Métros Gaîté, Pernety, Montparnasse. Sonner à « April » sur l’interphone.

Le téléphone du local 01 78 76 92 80.L’Apéro a lieu à Paris notamment parce que le local s’y trouve ainsi que les permanents et de nombreux actifs. Pour les apéros dans les autres villes voir sur le pad plus bas.

En ouverture de l’apéro nous ferons un court point sur les dossiers/actions en cours.

Le glou et le miam

Vous pouvez apporter de quoi boire et manger afin de reprendre des forces régulièrement. Nous prévoirons bien sûr un minimum vital.

Vous pouvez vous inscrire sur le pad.

- Bâtiment 8, 44/46 rue de l’Ouest, Paris, Île-de-France, France

- Adresse web https://pad.april.org/p/aperosapriljuin2018

- Tags apéro, april, rencontre

[FR Dijon] Atelier de création numérique et électronique - Le vendredi 29 juin 2018 de 20h30 à 23h59.

Le fablab et hackerspace l’abscisse vous propose comme tous les vendredis soir un atelier de création numérique et électronique.

L’atelier est équipé de différents outils perceuse, CNC, Arduino, Raspberry Pi, ordinateurs, oscilloscope, multimètre.

Une ressourcerie est à disposition, vous y trouverez des composants électroniques et des pièces détachées à prix libre.

Vous pouvez venir découvrir l’atelier et les usagers du fablab à partir de 20h30.

Vous pouvez aussi venir pour participer aux travaux numériques en cours, partager vos connaissances et vos savoir-faire.

Tous nos travaux sont libres et documentés sous licence libre.

- Fablab et hackerspace l’abscisse, 6 impasse Quentin, Dijon, Bourgogne-Franche-Comté, France

- Adresse web https://fablab.coagul.org

- Tags lab6, coagul, électronique, atelier, fablab

[FR Saint-Jean-de-Védas] Repair Café - Le samedi 30 juin 2018 de 09h00 à 13h00.

Nous vous proposons ce rendez-vous, où, bricoleurs, acteurs, bénévoles, associations, vous attendent pour vous aider à donner une deuxième vie à vos objets.

Réparer ensemble, c’est l’idée des Repair Cafés dont l’entrée est ouverte à tous. Outils et matériel sont disponibles à l’endroit où est organisé le Repair Café, pour faire toutes les réparations possibles et imaginables. Vêtements, meubles, appareils électriques, bicyclettes, vaisselle, objets utiles, jouets, et autres. D’autre part sont présents dans le Repair Café des experts bénévoles, qui ont une connaissance et une compétence de la réparation dans toutes sortes de domaines.

On y apporte des objets en mauvais état qu’on a chez soi. Et on se met à l’ouvrage avec les gens du métier. Il y a toujours quelque chose à apprendre au Repair Café. Ceux qui n’ont rien à réparer prennent un café ou un thé, ou aident à réparer un objet appartenant à un autre. On peut aussi toujours y trouver des idées à la table de lecture qui propose des ouvrages sur la réparation et le bricolage.

Repair Café est un atelier consacré à la réparation d’objets et organisé à un niveau local, entre des personnes qui habitent ou fréquentent un même endroit, par exemple un quartier ou un village. Ces personnes se rencontrent périodiquement en un lieu déterminé, dans un café, une salle des fêtes ou un local associatif où des outils sont mis à leur disposition et où ils peuvent réparer un objet qu’ils ont apporté, aidés par des volontaires.

Les objectifs de cette démarche alternative sont divers

- réduire les déchets

- préserver l’art de réparer des objets

- renforcer la cohésion sociale entre les habitants des environs

Seront présents

- Autour.com : On se rend des services entre voisins, on partage des infos, on prête, on loue, on donne…

- L’Accorderie : Est un système d’échange de services entre habitants d’un même quartier ou d’une même ville.

- La Gerbe : Contribuer à la formation de citoyens éveillés, engagés et solidaires en offrant aux enfants et aux jeunes un espace privilégié d’expression et d’épanouissement Crèche, Centre de loisirs, Scoutisme, Ateliers, chacun peut y trouver un cadre pour son développement grâce au travail d’une équipe de professionnels et de bénévoles.

- Les Compagnons Bâtisseurs : Prévoient d’amener des outils

- Les Petits Débrouillards : est un réseau national de culture scientifique et technique, ils viendront avec pleins de conseils et une imprimante 3D.

- Le Faubourg : Hébergera le Repear Café.

- Montpel’libre : Sera là avec des pièces informatiques, pour essayer de reconditionner des ordinateurs, dépanner ceux qui ne fonctionnent plus, expliquer comment ça marche, faire comprendre le choix judicieux du logiciel libre, contourner l’obsolescence programmée grâce à GNU/Linux, comment réparer et entretenir son matériel soi-même, nous porterons un jerry.

- TechLabLR : Accompagne les projets à composantes technologiques afin de les amener au pré-prototype, puis les guider vers les structures d’accompagnements.

- Violons Dingues : Passionnés de la vie, des autres, de la culture, de l’art, du sport, de la mécanique, de la moto, de la photo, de la musique, des animaux, des insectes, des plantes, de l’environnement, enfin de tout ce qui circule (au propre comme au figuré) sur notre planète.

Zéro Waste Montpellier : La démarche « Zéro Waste » est une démarche positive pour aller vers une société zéro déchet et zéro gaspillage.

Maison des Associations, 18 bis rue Fon de l’Hospital, Saint-Jean-de-Védas, Occitanie, France

Adresse web http://montpel-libre.fr

Tags

montpel-libre, repair-cafe, atelier

[FR Casseneuil] Install Partie GNU/Linux - Le samedi 30 juin 2018 de 10h00 à 17h00.

Le Samedi 30 Juin les bénévoles d’aGeNUx sont invités dans les locaux d’Avec 2L pour une Install-party.

Venez découvrir et partager le monde du logiciel libre en toute sérénité.

Animation Libre et non payante.

Auberge Espagnole le midi.

Avec 2L se situe derrière la poste de Casseneuil

- Avec 2L, chemin de la Tuilerie, Casseneuil, Nouvelle-Aquitaine, France

- Adresse web http://www.agenux.org

- Tags install-party, agenux, logiciels-libres, gnu-linux

[FR Wintzenheim] Réunion du Club Linux - Le samedi 30 juin 2018 de 13h00 à 19h00.